比扩散模子快50倍!OpenAI发布多模态模子及时生成进展

发布日期:2024-10-31 12:13 点击次数:124

西风 发自 凹非寺

量子位 | 公众号 QbitAI

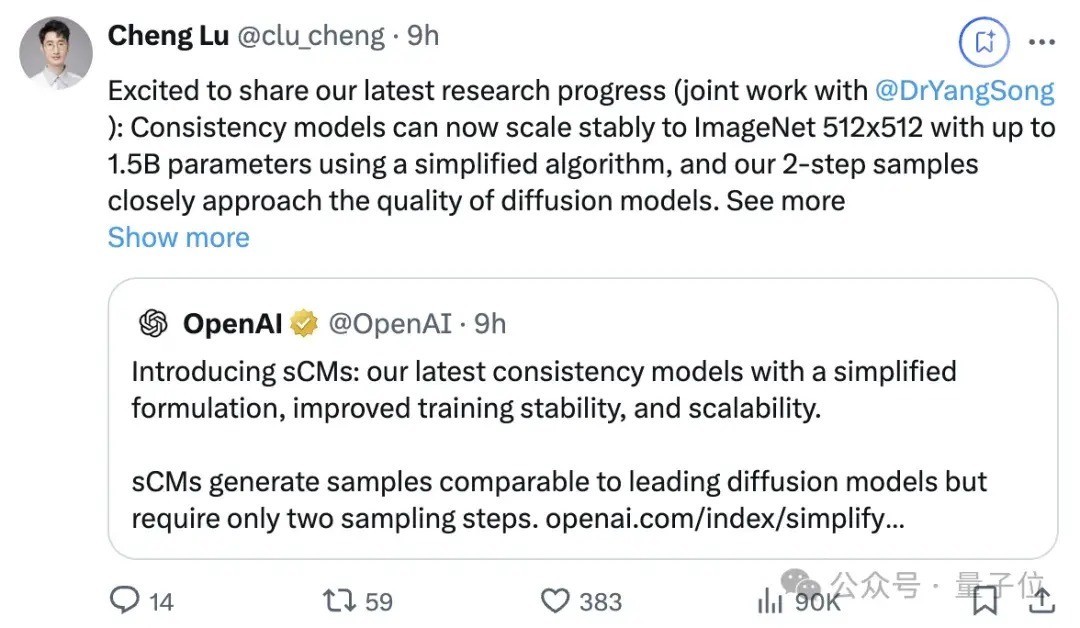

两位清华学友,在OpenAI发布最新询查——

生成图像,但速率是扩散模子的50倍。

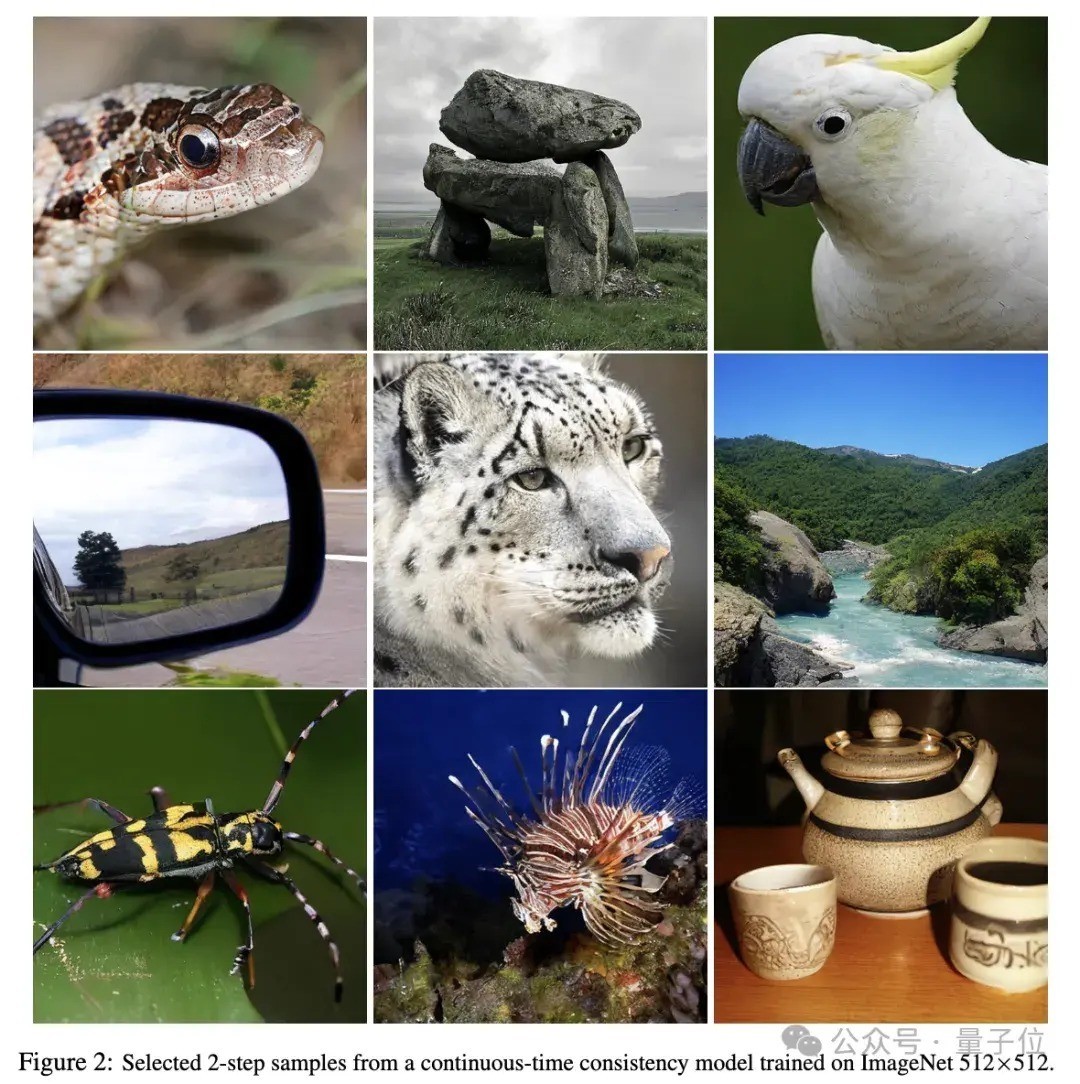

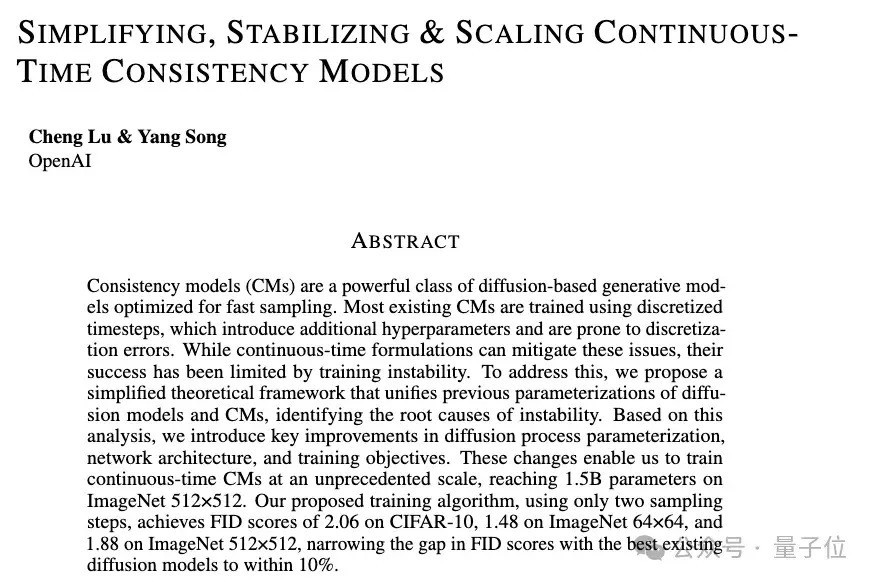

路橙、宋飏再次简化了一致性模子,仅用两步采样,就能使生成质料与扩散模子相比好意思。

他们奏凯将一语气时候一致性模子的检会鸿沟扩张到了前所未有的15亿参数,并竣事了在512×512分离率的ImageNet数据集上的检会。

参数15亿模子在单张A100 GPU上无需任何推理优化即可在0.11秒内生成一个样本。

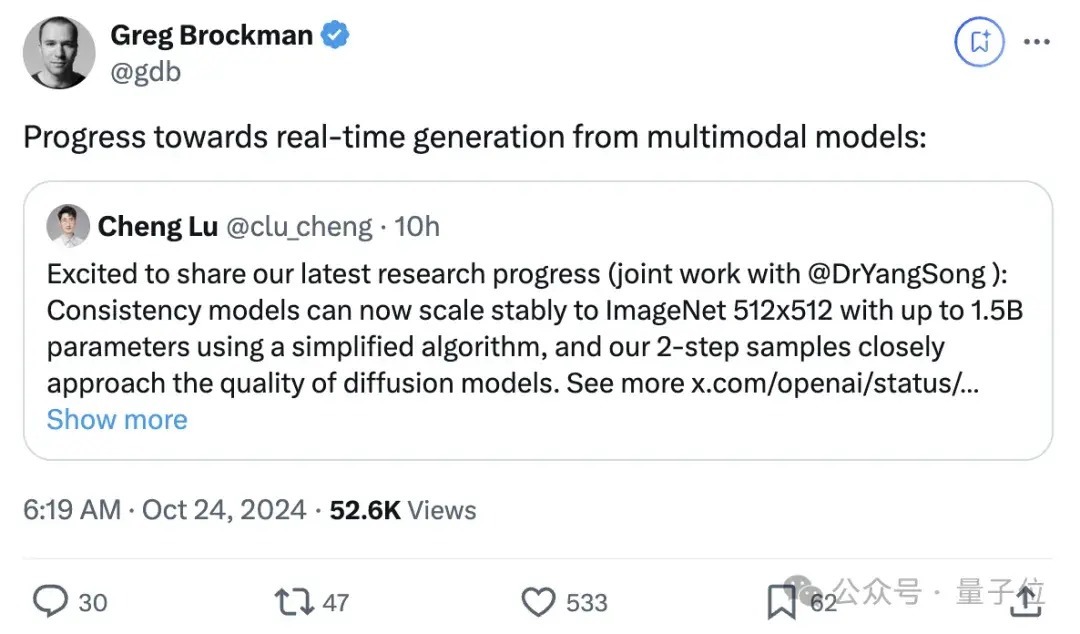

团队还默示通过定制系统优化,不错进一步加快,为及时生成图像、音频和视频提供新的可能。

值得一提的是,论文仅有的两位作家还都是清华学友。

该项询查发布后得到大都网友点赞转发。

把正在放假的Openai总裁Greg Brockman都炸出来了:

多模态模子正迈向及时生成。

那么,sCM是若何竣事的?

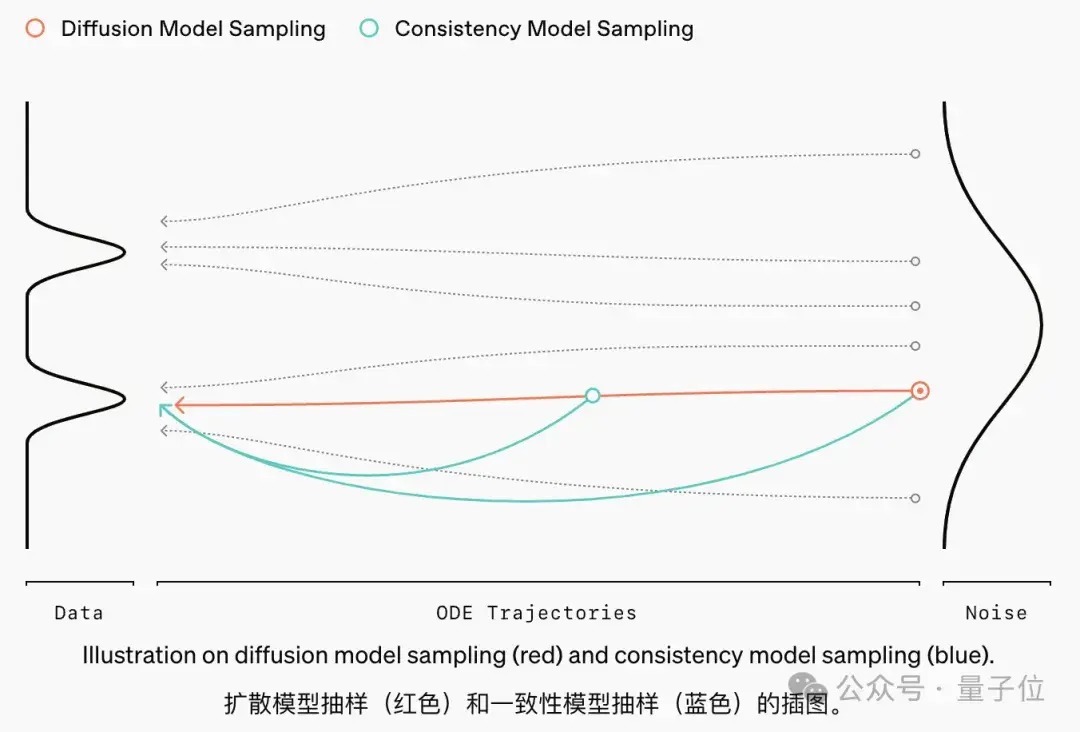

两步采样,50倍加快一致性模子是一种快速的扩散模子替代决策。

刻下扩散模子的采样要领频繁需要数十到数百个一语气要领智力生成单个样本,这截止了其及时愚弄的效果和可扩张性。

与逐渐通过大都去噪要领生成样本的扩散模子不同,它旨在一步顺利将噪声转化为无噪声样本。

OpenAI最新这项询查建议了一种革新一语气时候一致性模子(Continuous-time Consistency Models)的概述要领,主要包含题目中提到的三个重要点:简化、沉稳和扩张。

论文指出,现存一致性模子主要接收闹翻时候步检会,这种要理会引入稀零的超参数并容易产生闹翻化流毒。尽管一语气时候公式不错幸免这些问题,但之前的责任中一语气时候一致性模子长期濒临检会不沉稳的挑战。

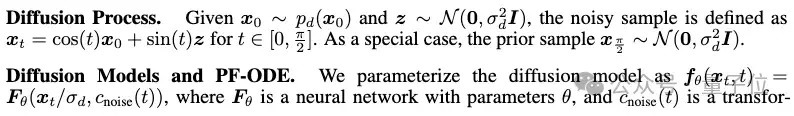

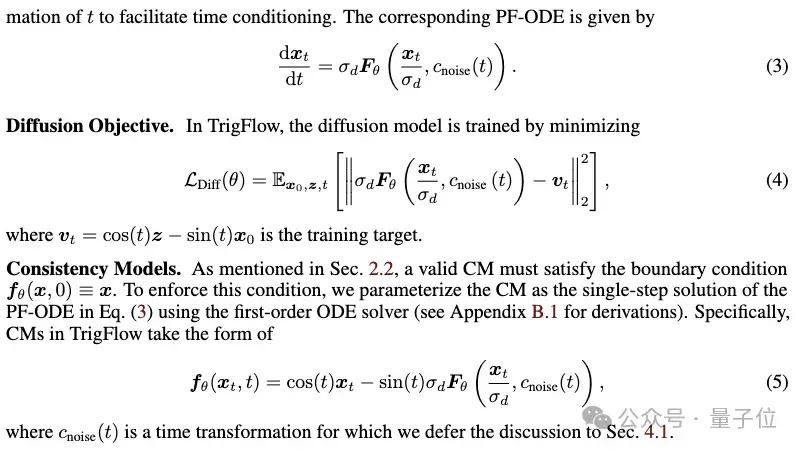

为此,论文最初建议了TrigFlow,私密地结伴了EDM(Exponential Diffusion Model)和Flow Matching两种要领。

TrigFlow使扩散经由、扩散模子参数化、PF-ODE、扩散检会主张和一致性模子参数化都粗略领有圣洁的抒发式,如下所示。

在此基础上,询查东说念主员潜入分析了导致检会一语气时候一致性模子不沉稳的原因。

在TrigFlow框架的基础上引入了几项表面上的革新,要点是参数化、收集架构和检会主张。

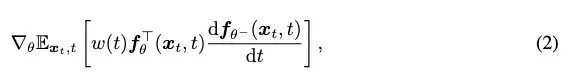

一语气时候一致性模子检会的重要是:

取决于:

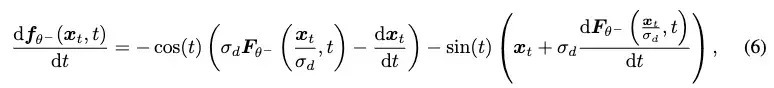

经过进一步分析,询查东说念主员发现不沉稳源自于时候导数:

并据此建议了三个重要革新:

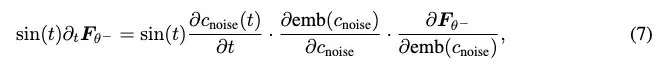

接收恒等时候变换c_noise(t)=t代替原有的对数正切变换,幸免了t接近π/2时的数值不沉稳性;使用位置时候镶嵌替代傅里叶镶嵌,减少了导数颠簸;引入自适应双重归一化层替代AdaGN,在保合手模子抒发才略的同期普及了检会沉稳性。此外,论文还革新了检会主张,包括切向量归一化和自适应权重等技能。

以上种种革新使得询查东说念主员奏凯将时候一致性模子的检会鸿沟扩张到15亿参数,并在多个基准数据集上进展优异。

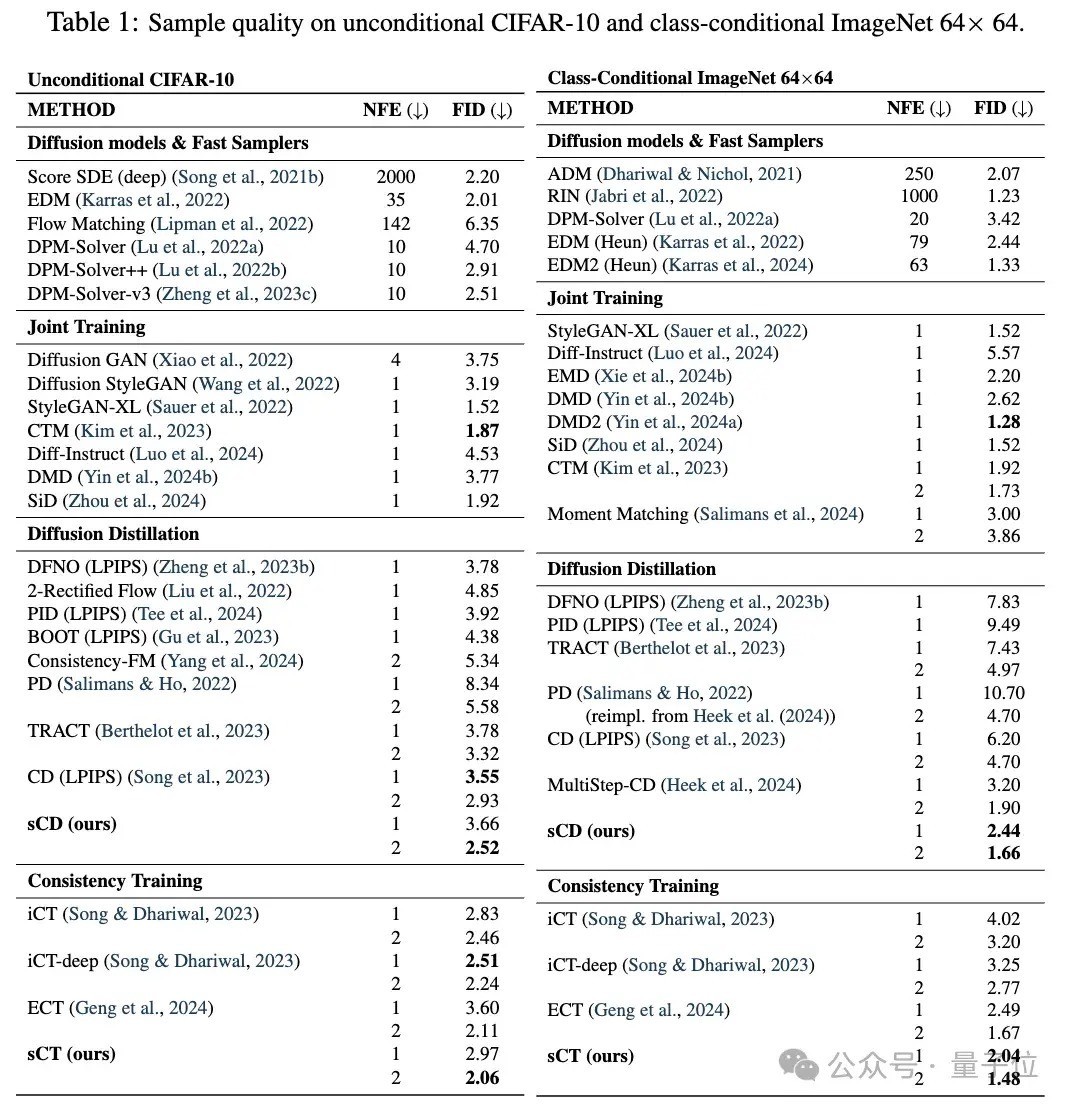

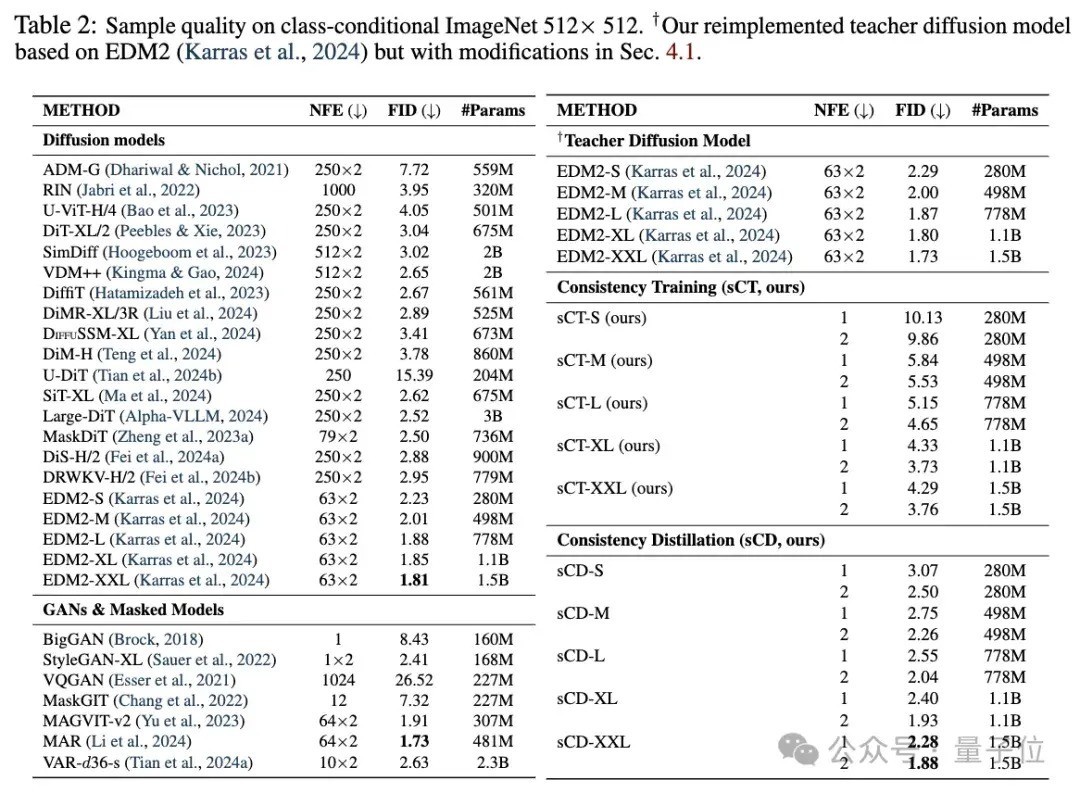

CIFAR-10上的FID(越低越好)为2.06,ImageNet 64×64上为1.48,ImageNet 512×512上为1.88。

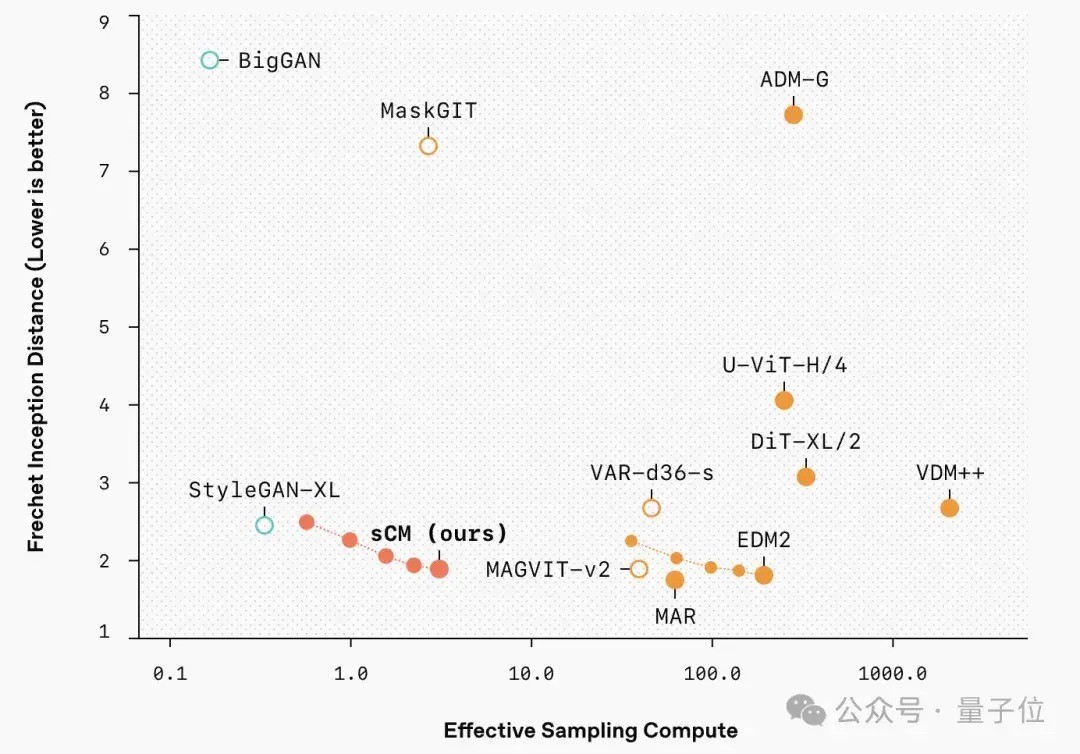

杰出值得刺眼的是,这些模子只需要两步采样就能达到接近最佳的扩散模子的生成质料(FID差距在10%以内),而计算支拨仅为后者的10%。

询查东说念主员还相比了革新后的一致性模子与变分分数蒸馏(VSD)要领的区别,发现一致性模子能产生更各样的样本,况且在更高的雷同水平下进展更好。

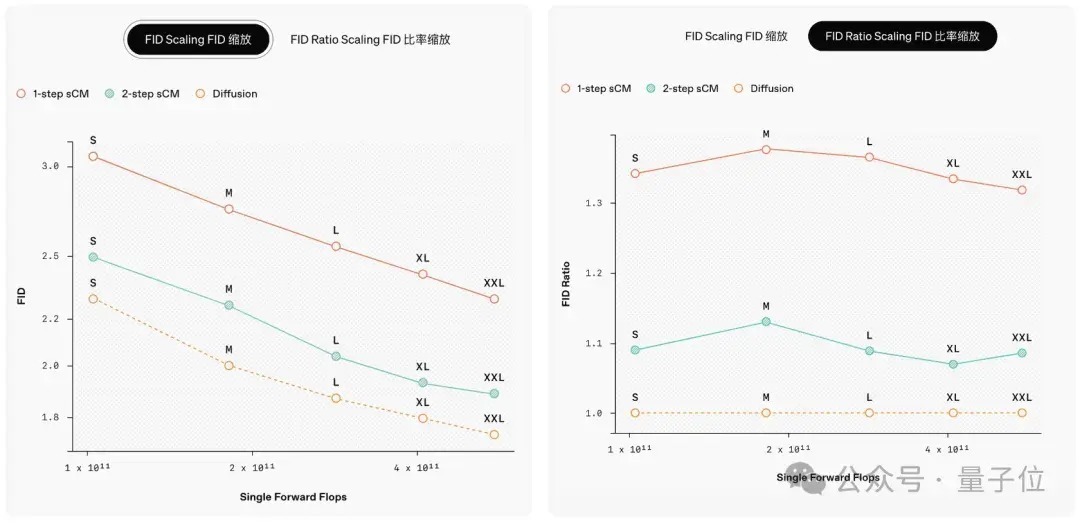

他们还有一个重要发现,跟着teacher扩散模子的鸿沟扩大,sCM的革新也呈比例加多。

用FID分数的比率来推测样内容量的相对各异在模子大小不同的鸿沟上是一致的,这意味着当模子鸿沟加多时,样内容量的完全各异会减小。

此外,加多sCM的采样要领不错进一步减少质料差距。

作家简介

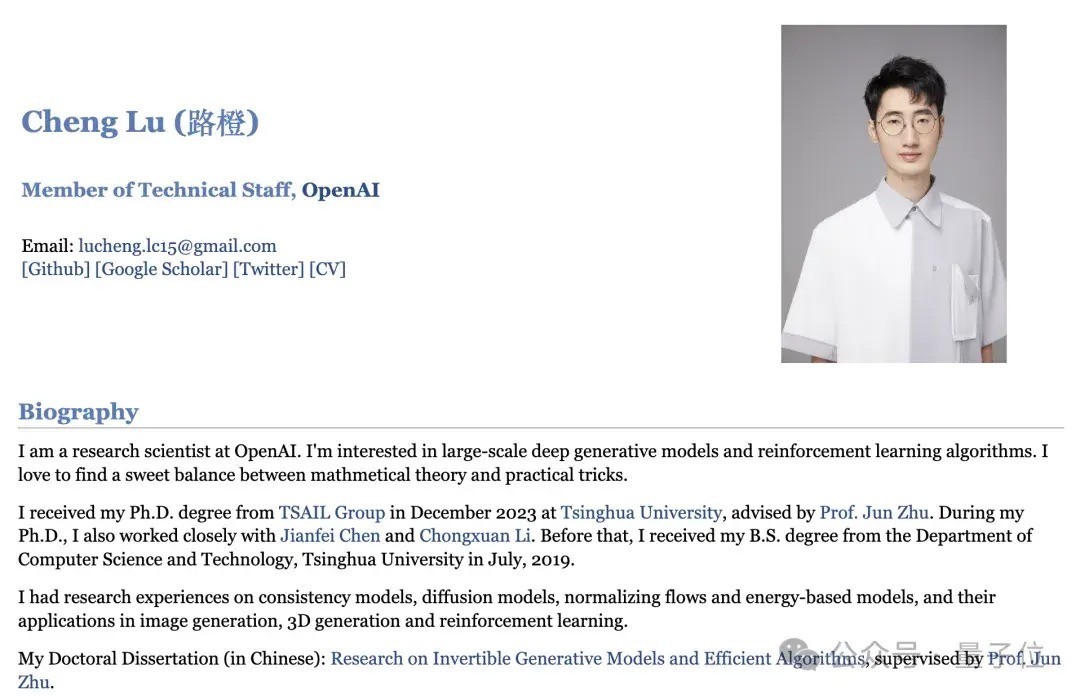

路橙

旧年在清华大学TSAIL实验室,在朱军训导携带下获取博士学位;2019年获清华大学计算机科学与技能系学士学位。

咫尺他是OpenAI询查科学家,对大鸿沟深度生成模子和强化学习算法感兴趣。

可爱在数学表面和实践愚弄技能之间找到理思的均衡点。

他对一致性模子、扩散模子、归一化流和基于能量的模子颠倒在图像生成、3D 生成和强化学习中的愚弄有丰富的询查教养。

宋飏

宋飏在清华大学获数学和物理学士学位后,在斯坦福大学获取了计算机科学博士学位,导师Stefano Ermon。

其询查主张是建立粗略贯穿、生成并处治多种形状高维数据的弘远AI模子。

咫尺,宋飏专注于革壮盛成模子,包括它们的检会要领、架构规划、对王人、鲁棒性、评估技能及推理效果。

他对探索生成模子算作科学发现器具的后劲也很感兴趣。

参考连结:[1]https://x.com/OpenAI/status/1849139783362347293[2]https://luchengthu.github.io/[3]https://yang-song.net/

— 完 —

量子位 QbitAI · 头条号签约

善良咱们,第一时候获知前沿科技动态